Artigo

A Arquitetura da Autonomia: Por que sua Plataforma de Aplicações não Consegue Lidar com Agentes de Fronteira

PPaulo FrugisCTO da Elevata2 de fevereiro de 20267 min de leitura

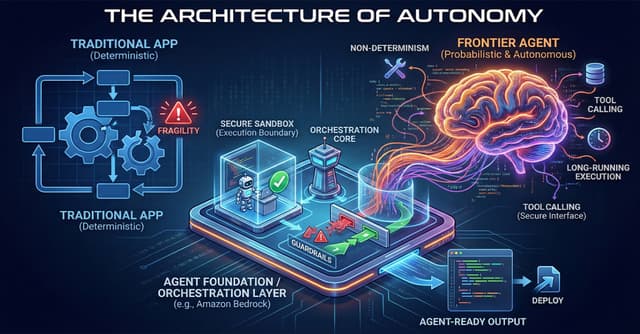

Estamos presenciando uma transformação silenciosa mas profunda no cenário do software. Nos últimos dois anos, a indústria esteve na "Fase de Lua de Mel" da IA Generativa, obcecada por Chatbots, Copilots e sistemas RAG (Retrieval-Augmented Generation) que resumem PDFs. Essa fase está terminando. O mercado não recompensa mais a novidade; ele exige execução. A próxima fronteira não é sobre conversar com uma IA; é sobre delegar trabalho a ela. Estamos nos movendo em direção aos Agentes de Fronteira — sistemas de software autônomos capazes de receber uma instrução de alto nível (por exemplo, "Atualize nossos microsserviços Java 11 para Java 17 e corrija todas as mudanças incompatíveis"), trabalhar nela por dias, navegar por erros e entregar um Pull Request pronto para produção. No entanto, a maioria das organizações de engenharia está caindo em uma armadilha. Elas estão tentando construir esses agentes autônomos usando os mesmos padrões arquiteturais que usaram para aplicações stateless ou chatbots simples. Esse é um erro catastrófico. Agentes são fundamentalmente diferentes de aplicações tradicionais. Tratá-los da mesma forma causa fragilidade, riscos de segurança e custos explosivos. Para passar de "Brinquedos" para "Funcionários Digitais", precisamos entender por que a arquitetura antiga falha e definir os novos Primitivos Arquiteturais de Agentes necessários para ter sucesso.

O Atrito Central: Mentes Probabilísticas em Sistemas Determinísticos

Para entender por que "apenas adicionar um LLM" ao seu backend falha, você deve compreender o choque fundamental entre a engenharia de software moderna e a Inteligência Artificial. O software tradicional é determinístico. Quando você escreve um teste unitário para uma API bancária, você espera que 10 + 10 seja igual a 20 sempre. Todo nosso ecossistema DevOps — pipelines CI/CD, linters, compiladores — é construído sobre esse pressuposto de previsibilidade. Agentes de Fronteira, no entanto, são probabilísticos. Execute o mesmo prompt através do Claude 3.5 Sonnet ou GPT-4o três vezes, e você pode obter três abordagens ligeiramente diferentes para resolver um problema de código. Quando você incorpora um "cérebro" probabilístico em um pipeline determinístico, você introduz caos.- O "Teste Frágil" Potencializado: No software tradicional, um teste frágil é uma inconveniência. Em fluxos de agentes, "fragilidade" é uma característica do mecanismo de inteligência.

- A Alucinação em Cascata: Se um microsserviço padrão falha, ele lança um erro 500 e para. Se um Agente "falha" (alucina), ele frequentemente continua com confiança, acumulando código ruim sobre lógica ruim por horas antes que alguém perceba.

O Que Torna os Agentes Diferentes? (Os Três Vetores do Caos)

1. Não-Determinismo e a "Lacuna de Validação"

Em uma aplicação padrão, você valida entradas. Em uma aplicação baseada em agentes, você deve validar raciocínio. Um agente encarregado de refatorar um script Python pode decidir trocar uma biblioteca por uma mais moderna. Isso não é apenas uma mudança de sintaxe; é uma decisão semântica. Um pipeline determinístico não consegue detectar isso se o código compilar tecnicamente. O Risco: Você não pode contar apenas com "Conjuntos de Dados de Ouro" ou testes unitários estáticos. Você precisa de ambientes de avaliação dinâmicos que possam julgar a intenção do código, não apenas sua sintaxe.2. Tool Calling: As "Mãos" do Agente

Um modelo de geração de texto (Chatbot) é seguro porque vive em um quarto acolchoado. Um Agente é perigoso porque tem mãos. Para funcionar, um Agente precisa de ferramentas: acesso ao sistema de arquivos, capacidade de executar comandos shell, acesso git e direitos de consulta de banco de dados. O Problema: LLMs são notoriamente ruins em aderir a esquemas de API rigorosos em contextos longos. Eles podem "alucinar" um parâmetro que não existe (--force-override) ou usar mal uma ferramenta destrutiva (rm -rf) com base em uma instrução mal compreendida. A Lacuna Arquitetural: Gateways de API padrão são projetados para humanos autenticados ou código, não para "intenção nebulosa" de uma IA. Você precisa de uma camada intermediária que sanitize e valide o uso de ferramentas antes de chegar à sua infraestrutura.3. Execução de Longa Duração e Desvio de Estado

Esse é o assassino silencioso de projetos de agentes. Uma sessão de chat com usuário dura 5 minutos. Uma tarefa complexa de engenharia de software pode levar horas ou até dias de trabalho autônomo.- A Armadilha da Janela de Contexto: Enquanto o agente trabalha, ele gera logs, diffs e pensamentos. Esses dados rapidamente excedem a janela de contexto (memória) até dos maiores modelos.

- Desvio de Estado: Sem uma arquitetura robusta de memória, o agente "esquece" por que iniciou a tarefa. Vi agentes entrarem em loops onde corrigem um bug no Arquivo A, criando um bug no Arquivo B, depois corrigem o Arquivo B, quebrando o Arquivo A, queimando tokens infinitamente porque perderam o "Estado Global" do projeto.

Os Primitivos Arquiteturais que Agentes Realmente Precisam

Você não consegue resolver esses problemas com engenharia de prompts. Você os resolve com Arquitetura. Especificamente, dentro do ecossistema AWS (usando Amazon Bedrock como núcleo), estamos vendo uma nova stack emergir.1. Orquestração (O Sistema Nervoso)

Você precisa de uma máquina de estados, não um script. Simplesmente fazer loop em um script Python é insuficiente para produção. Você precisa de um orquestrador durável, como AWS Step Functions ou Amazon Bedrock Agents.- Por quê? Se o Agente cair ou a API expirar após 4 horas de trabalho, você precisa retomar exatamente de onde parou.

- Humano no Loop: O orquestrador permite "Checkpoints". Antes do Agente executar git push ou DROP TABLE, a máquina de estados pausa, envia uma notificação SNS para um Engenheiro Sênior e aguarda aprovação manual.

2. Limites de Execução Segura (O Sandbox)

Este é o componente mais importante. Um Agente nunca deve executar código no mesmo ambiente que o orquestra. Se seu Agente escreve um script Python, esse script deve rodar em um sandbox efêmero e isolado.- O Loop de Feedback: No Amazon Bedrock, isso é tratado via Code Interpreters. O Agente escreve código -> O Sandbox executa -> O Sandbox retorna StandardOutput ou StandardError.

- O Efeito "Grounding": Se o Agente alucina uma biblioteca que não existe, o Sandbox retorna um ImportError. Esse erro é o remédio para alucinação.

3. Guardrails como Infraestrutura

Segurança não pode ser um pedido educado no System Prompt. Deve ser uma restrição de infraestrutura rígida. Usando Amazon Bedrock Guardrails, você pode definir "Negação de Tópicos" e "Filtragem de Conteúdo" no nível da plataforma.- Exemplo: Se um Agente trabalhando em uma tarefa frontend tenta consultar o banco de dados usando uma ferramenta que não deveria acessar, o Guardrail intercepta a chamada e retorna "Permissão Negada". Essa é "Defesa em Profundidade" para IA.

Operacionalizando Autonomia

Uma vez que você tem a arquitetura, como monitora isso? Você precisa de Observabilidade Semântica.A Nova Stack de Métricas

- Pass@k (Taxa de Sucesso): Se o Agente executa a tarefa 10 vezes, quantas vezes resulta em testes passando?

- Taxa de Erro de Ferramenta: Um pico nessa métrica indica que o Agente está confuso sobre como usar suas ferramentas.

- Detecção de Loop: Monitore padrões de pensamento repetitivos. Se o rastreamento mostra o Agente executando os mesmos comandos repetidamente, está preso. Mate o processo.

TDD para IA: O Fluxo de Trabalho Ouro

A única forma de confiar em um Agente é forçá-lo a usar Test-Driven Development (TDD):- Explorar: Agente explora a base de código para entender o contexto.

- Reprodução: Agente escreve um teste que falha (reproduzindo o bug).

- Verificação: Agente executa o teste no Sandbox. Confirma falha.

- Implementação: Agente escreve a correção.

- Validação: Agente executa o teste novamente. Passa.

- Roteamento de Modelo: Use um "Router" para enviar tarefas simples para modelos menores e mais baratos, e reserve Modelos de Fronteira apenas para tarefas de raciocínio complexo.

- Orçamento por Sessão: Implemente um "Token Cap" por execução. Se um agente não resolveu o problema dentro de um orçamento definido, provavelmente está perdido.

Conclusão: O Futuro "Pronto para Agentes"

Estamos entrando em um mundo onde software constrói software. A vantagem competitiva da próxima década não será apenas ter os melhores desenvolvedores; será ter a melhor Infraestrutura de Agentes. As organizações que tratam Agentes com o rigor de engenharia de um microsserviço construirão "Fábricas Digitais" que rodam 24/7. As que os tratam como chatbots construirão brinquedos caros. A questão não é se você usará Agentes, mas se sua arquitetura está pronta para sobreviver a eles.Relacionados

Continue lendo

Leituras relacionadas a este tema.

Insight

02/02/2026

8 min de leitura

IA Generativa No-Code: Como Construir Agentes de Automação com Quick Flows e Quick Automate

Continuar leitura

Insight

02/02/2026

8 min de leitura

O Paradoxo da Nuvem: Por Que Sua Estratégia Milionária de Cloud Ainda Parece um Data Center Old School

Continuar leitura

Insight

04/10/2025

2 min de leitura